Это копия, сохраненная 9 июня 2019 года.

Скачать тред: только с превью, с превью и прикрепленными файлами.

Второй вариант может долго скачиваться. Файлы будут только в живых или недавно утонувших тредах. Подробнее

Если вам полезен архив М.Двача, пожертвуйте на оплату сервера.

Пока без шапки, в процессе сделаем.

Обсуждаем вопросы сведения треков, делимся советами, трюками, видео, книгами и так далее.

39 Кб, 600x398

39 Кб, 600x398Исходники для сведения скопировал из шапки старого треда:

1) rutracker.org - пишешь в поиске слово multitrack

2) cambridge-mt.com/ms-mtk.htm

3) puremix.net

Ссылки на прошлые треды:

https://2ch.hk/mus/arch/2017-05-31/res/403552.html (

https://2ch.hk/mus/arch/2017-10-20/res/437766.html (

Ну вбрось парочку треков на какой-нибудь яндекс-диск. Кому интересно (мне например) попробуют и вкинут результаты в тред. Только если можешь, свои миди-барабаны не одной дорожкой кидай.

Удвою этого. Я например могу попробовать тоже, потом выберешь себе понравившиеся трек.

https://www.soundgym.co

Кто-нибудь пробовал заниматься на этом сайте?

>>581742

>>581745

Вывел проект 2804 в wav, в папке raw лежат дополнительно необработанные инструменты, записанные в линию. Постарался чтобы все было примерно -6 db и не клиповало

https://drive.google.com/open?id=1OtS36iFLOGzGgU7ykqwThxviJtiCLkpC

9,2 Мб, mp3

9,2 Мб, mp3Ну в мастеринг и сведение я не могу, от скуки сделал вот, тупо на слух.

> А тут ударные валят весь трек, их бы наоборот прибрать. Еще прописать динамику между частями лучше и будет заебок

Ты тот кто реквестировал? Я в принципе могу посидеть ещё с треком если хочешь.

Я просто наспех делал.

подписался на рассылку этого чела. Присылает видео, которых у него нет на канале ютуба. Интересно рассказывает, а главное он сам тебе присылает и это распределено по времени.

это довольно тупой вопрос, скорее всего, учитывая процесс создания такого музла, но всё же.

https://soundcloud.com/flexzig/allengnzgo

И подобную электронщину

https://soundcloud.com/brokennote/dustandshadows

И для сравнения, вот это моё, по сведосу я попадаю хоть немного в рефы выше? Т.к пишу с ведра, лосслес принести не могу.

https://soundcloud.com/followmoth/ep-teaser

бамп, шоб тред с нулевой не уплыл.

Блин, так и знал что что-то с мид сайдом связаное будет. Спасибо

Вот я сейчас скопировал трек гитары и сделал задержку трека на 1мс. Сразу стало широко, но в анализаторе появилась небольшая противофаза. Что странно, я же просто чуть-чуть сместил по времени дорожку. В моно всё еще звучит нормально, но хотелось бы, чтобы все было в синенькой зоне. С другой стороны, я смотрел трек радиохеда там тоже была противофаза чуть-чуть

https://youtu.be/j7Rxl3P4wkg?t=26s

https://youtu.be/_oqWdZsBYuE

>скопировал трек гитары и сделал задержку трека на 1мс. Сразу стало широко

Ха-ха-ха-ха, аааааааа

Широко не стало. Ввиду малого слухового опыта, ты перекошенные фазы между каналами принимаешь за расширение. Все когда то через это проходили. Не пытайся наебать систему, единственный способ получить широкое стерео - это две прописанные партии.

Ну не соглашусь. Противофаза есть конечно, но это не так страшно.

Во-вторых, я как-то ходил на курсы, там звукорежиссер говорил что не обязательно сегодня записывать две дорожки вокала, например. Можно все в миксе сделать. Не углублялся я тогда, но в память запало.

В-третьих, на ютубе полно таких туториалов, там либо трек замедляют, либо чуть-чуть детюнят, либо хорус накладывают. Но это больше к электронным относится как-будто.

А так, меня больше интересует именно вопрос освобождения центра, а не расширения стерео, хотя и это интересно.

вот тут >>583720 я описал задачу, у mgmt хорошо слышно этот эффект.

689 Кб, 702x664

689 Кб, 702x664>ходил на курсы

>звукорежиссер говорил что не обязательно сегодня записывать две дорожки вокала

>можно все в миксе сделать

>не рассказал, как освобождать центр под вокал

Ну просто классика отечественной системы наебизнеса преподавания "звукорежиссуры" лохам "начинающим продюсерам"!

Панорама, hp/lc фильтры, ревера... Короче, начинай свое обучение с начала. Наверни Гибсона, например - https://www.youtube.com/watch?v=TEjOdqZFvhY

Не, это был курс именно звукозаписи и он был так себе на самом деле. Так что это был просто разговор в перерыве.

51 Кб, 480x480

51 Кб, 480x480Но ведь это не будет широким стерео. Это будет две моно записи гитары.

Ага. А большой оркестр - это набор соло инструментов в моно, которые рассажены по панораме

Нихера с тебя не выйдет толкового. Ты лошок, для которых проводят курсы и пилят видосики. Учись думать сам, не будь дном .

Если все эти инструменты записывать по отдельности в моно, то да, будет куча моно записей.

5,5 Мб, mp3

5,5 Мб, mp3Лень автоматизацию делать, инструменты по одному, особенно во вступлении звучат плохо. Нужно ставить автоматизацию ревера и эквалайзера на первых две вступающих дорожки.

Запись кстати очень хорошая, как вы (ты?) умудрились испортить запись - не понятно.

4,1 Мб, mp3

4,1 Мб, mp3Почитай описание к видео, лол.

Трек не сводили, не мастерили, проект вообще потеряли, осталась только mp3, на альбом запись не попала.

Но при этом звучит нормально.

Сведение и мастеринг оверрейтед, 99% всего происходит на записи.

И тем не менее звучит хорошо, можно на радио выпускать, на ютуб.

Во первых это не бит за 2 часа, во вторых >>587040 явно сводили (работа в дав да еще и с электронной музыкой подразумевает еще и сведение в любом случае). Прост обычно чувакам на студию присылают мультитреки, которые уже доводят до ума. Именно это она и имеет ввиду под mixing/ mastering, т.е. не отправляла трек профи в этой области. Как бы вы нпр. дома не сводили и не мучались над своими треками, если вы музыканты, по сути в профессиональном мире их так же можно назвать демками "без сведения и мастеринга", тупо из принципа разделения труда.

По поводу того, что "хоть на радио" - ну у граймс стилистика такая действительно. Там и не должно все звучать чисто, с глубоким пространством или специально для больших клубов и т.д. и т.п. Достаточно чтобы просто качало. Поэтому непонятна фраза про сведение оверрейтед. Не у всех есть привычка работать на высокой громкости, особенно дома, а тихие и не динамичные готовые треки сейчас все в основном скипают толком не начав слушать. Тоже уметь надо между прочем - вырулить громкость как надо (а надо сильно к сожалению) не убив к херам звучание.

проходил мимо

лол, а ты смешной. говно, что с ревером что без

38 Кб, 600x540

38 Кб, 600x540Подскажите радикальные способы изменить/извратить исходный сэмпл. Такие существенные как реверс, может есть какой-то сорт оф звуковой негатив, как с фотками. Чуть менее существенные еще дисторшны всякие, изменение питча и/или длины, эквализация, нарезки всякие, перестановка...

Что еще?

> звуковой негатив

Инверсия же. Хотя звучать будет так же.

> Что еще?

Просто хуячишь кучу плагинов и готово. Сатурацию там, LFO, delay, reverse reverb/delay, компрессор/лимитер, в общем все, что видишь.

Wave shaper заюзай, инвертируй просто зависимость выходного звука от входного и будет аналогично инверсии у фоток, но ухи береги.

В harmor закинешь сэмпл и извратишь его до неузнаваемости.

Пусть выделяются. Делай так:

1) По громкости сведи сначала, без всяких обработок. Если не получается просто по громкости инструментов сделать норм звук, значит вмешивайся в нотки, велосити, хуелосити, перенакручивай звук, переигрывай, перезаписывай. Когда хорошо сыграно, само звукоизвлечение, уже должно нормалек звучать, без всяких компрессоров и эквалайзеров.

2) Отрежь/убавь незначительные для каждого инструмента области спектра.

3) Инструменты, у которых спектры похожи и значительно пересекаются, одновременно включи и в моно эквалайзером добейся, чтобы максимально оба было слышно в моно. Желательно выключить один монитор, потому что физически моники отличаются чуть-чуть и уши человека не идеально одинаковые и комната может быть не симметрична. Так с одного моника ты можешь чуть-чуть лучше услышать один инструмент, а с другого другой инструмент. На практике всем это лень делать, но формально, моно - это один включенный моник.

4) Панораму добавляй, должен быть включен circular panning law, без него работают только долбоебы.

5) Еще эквалайзь уже с панорамой, чтобы пространство заебенить.

6) Добавь художественные эффекты и компрессию, если надо. Может так статься, что и не надо.

7) Ебани ревера, если надо. Может так статься, что и не надо. Ну, чуть-чуть может. Некоторые инструменты любят дилей, с лоупасом, еле заметно.

А дальше мустиринг, хуюстиринг. Если хочешь громко и переносимость говникса, то отрежь очень низкие и очень высокие частоты и многополосным компрессором пожми и сравнивай с непожатым вариантом уравненным по громкости (субъективной), так, чтобы ты жал сильней, а звук оставался примерно таким, как был, чтобы не искажалось. Сейчас все говорят, что громко не модно и любят динамику. Если само исполнение музыки не было произведено с макродинамикой, то через лимитер хуярь либо усиление побольше в местах, где должно ебашить, либо перед этим местом слегка ослабляй постепенно, чтобы тип без палева.

https://www.youtube.com/watch?v=4FKTJhgCflY

Анальноговое суммирование.

Может быть чел, конечно, не подписывается за это говно, а просто рекламирует, но как-то все равно неприятно.

Ладно, он сказал, что иначе бы пришлось рекламироваться у казиношников. Значит наверно они не подписываются за хуйню, а просто рекламируют.

Значит можно позырить.

Как создавать динамику в песне при её написании?

Я заебался уже

Звучит все более-менее, но нет той самой динамики

Автоматизацией на посте, либо акцентированием при записи.

http://rgho.st/7jvTtpYlX

В чём плюсы и минусы каждого?

Что лучше и для каких целей?

3 Кб, 225x225

3 Кб, 225x225У Рипера это помню, как-то фиксилось, а у Аудишена как?

Во-первых, не помогает. Во-вторых, с чего ему вообще помогать в таком случае?

транзиент дизайнер

бамп вопросу

Деклиппер (что бы это не значило), динамический эквалайзер или многополосный компрессор, или спектральный компрессор. Условие задачи слишком расплывчатое. Ударная волна при взрыве "п, б" имеет скорость превышающую скорость звука в материале из которого сделан корпус микрофона? Губы вокалиста разбрызгиваются по комнате? Деклиппер не поможет тогда.

21 Кб, 196x200

21 Кб, 196x200>Ударная волна при взрыве "п, б" имеет скорость превышающую скорость звука в материале из которого сделан корпус микрофона? Губы вокалиста разбрызгиваются по комнате?

Я, конечно, всё понимаю, но что это такое?

Ну тот чел мог бы приложить образец звука, чтобы понятно, в чем проблема точно, а не по описанию.

Я и есть "тот чел". Образец звука увы, уже проебал. Но, если что, вкину аналогичный в дальнейшем.

В самом ебучем случае izotope rx, если что. То есть если ты в микрофон сказал взрывную бээ и микрофон взъебался от ужаса и все заклиповало, то это как бы соответствует йобскому нелинейному преобразованию + может быть еще шум потока воздуха приплюсуется. Это чистить нужно чуть не вручную, а целью полагать частичное восстановление, превращения звука из неприятного в приемлемый. Обратное преобразование, которое могло бы восстановить предполагаемый качественно записанный соответствующий звук, наверно возможно теоретически с помощью каких-нибудь хитровыебанных нейросетей будущего.

Спасибо, бро.

Вот пример: https://www.youtube.com/watch?v=N-aK6JnyFmk

125 Кб, 600x600

125 Кб, 600x600Удвою.

Но меня интересует немного другое направление: как добиться винтажного звука 30-х?

Типа как вот здесь:

https://www.youtube.com/watch?v=AY2jPAb6BOQ - голос диктора

https://youtu.be/bGBwmLRNLJ4?t=2m13s - голос солиста

https://youtu.be/SOhO148hOi8?t=25s

https://youtu.be/tnLK5lMY97s?t=1m40s

Интересует в первую очередь голос, потом музыка.

9,3 Мб, mp3

9,3 Мб, mp3Чё скажете?

Эквалайзер, отрежь высокие и дисторшн (любые имитации нелинейных искажений). Но винтажность звука определяется прежде всего жанром и манерой исполнения. Если ты будешь сводить, то на каждую дорогу повесь нелинейное говно и ограничь спектр до 5-6 кгц.

>(любые имитации нелинейных искажений)

>нелинейное говно

Слушай, я нуб, не бейте сильно, но что такое нелинейные искажения?

Бамп вопросу на всякий случай.

Там в треках хуева куча всего, но звучит нормально, тем не менее.

Как они это делают?.

Какие вы можете выделить особенности подобных треков?

28 Кб, 1037x641

28 Кб, 1037x641Линейность означает пропорциональность между входом и выходом. Нелинейность - это отсутствие пропорциональности. Считай, что эквализация, реверберация, всякие дилей, хорусы и прочее - это принципиально линейно, но на практике это не обязательно. А всякие дисторшны, апмсимы, сатураторы - это нелинейно и без нелинейности они не делаются. Усек? Все звуковое оборудование физически имеет линейные и нелинейные искажения. Вот динамик у тебя не может хуярить выше определенной громкости, даже если ты подашь на него ебическое напряжение. А вот то, что он не может очень высокие частоты воспроизвести и очень низкие - это линейные искажения, конечно, в рамках матмадели в которой рассматривается данный объект. Вне этой модели не имеет смысла рассморение.

Усилки всякие, особенно олдовые, говенные аудиофильские, чмошные легендарные - у них кривая зависимость выходного сигнала от входного. Понял? Если бы она не была кривая, то не был бы говенный ебаный звук олдовой музыки. Его называют "теплый ламповый звук", не важно, лампа там или пленка, говненка, пластинка. Теплый звук - это искаженный говенный звук.

Тут наши полномочия все. Если челу надо, будет допытываться и переспрашивать всевозможными такими и этакими способами. А в пустоту я говорить не хочу.

Можно любую хуйню по идее пропустить через Antares Tube и любой лоупасс фильтр и получится теплый ламповый звук. И не надо покупать усилки за слезы девственницы и сперму дракона.

Спасибо, бро, красиво расписал, но нихуя не понятно, лол кек.

Но, впрочем, сам найду как-нибудь потом.

По этому принципу все, что написали какие-нибудь Noisia - это тоже демки без сведения и мастеринга. Особенно из того, что они писали в 2003-2005 годах, когда у них еще не было огромной студии с ебическими мониторами за 10k$ каждый. Я это говорю не в пику, а в подтверждение твоих слов.

В живой музыке более консервативный подход, когда пишут, сводят и мастерят разные люди. Ну и в дорогом попе вроде Кэти Перри тот же подход. А Граймс - это инди электронщина, причем чем менее профессиональное сведение, тем больше инди.

> ноизия

Конечно нет. Нормальные продюсеры вешают лимитер и эквалайзер на мастер ещё до того как какую-нибудь музыкальную идею напишешь. Написание такой музыки начинается со "сведения и мастеринга" и только потом начинаются композиторские потуги

232 Кб, 835x360

232 Кб, 835x360Я имел ввиду, что Noisia это пример отсутствия разделения труда. Как подменил анон выше, Граймс имела ввиду под сводкованием процесс, когда она отдает мультитрек звукачу, звукач сводит в студии и отдает фонограмму инженеру по мастерингу.

А так да, лимитер на мастер и вперед.

> Antares Tube

Этот плагин сам уже винтажный, старинный. ^.^

Есть куча всяких ампсимов, ignite amps, у многих из них есть режим clean, который отлично подойдет для имитации олдового звукозасерания.

Послушай как звучат мультитреки LP с рутрекера. Возможно ответишь на свой вопрос.

![zIXmpmpSnt0[1].jpg](/mus/big/thumb/581541/15317989037390s.jpg) 648 Кб, 1920x1080

648 Кб, 1920x1080Как-то так и это только сухой кик, дальше на групповой идёт магия со стереорасширителем и эквализацией, в случае линков ещё и агрессивный сатуратор, который добавляет искажений и собирает все инструменты кучу (никаких компрессоров в данном случае).

Дедмау5 говорил что не надо делать громче. Кому надо громче могут на своем устройстве сами громкость поднять.

нелинейные искажения - это доп. гармоники, которых раньше в сигнале не было.

Отрезал ты низ фильтром - это линейное искажение.

Захуярил ты дисторшн на мастер - получил кучу гармоник - это нелинейные искажения.

меньше басов - больше громкости можно выжать. Также визуально можно сделать микс ярче за счет поднятия высоких частот

88 Кб, 1592x686

88 Кб, 1592x686Доп. гармоники - это следствие нелинейного искажения, а не само нелинейное искажения. Нелинейное искажение может, например, убрать некоторые гармоники.

Включи tone generator и послушай высокие частоты (19кгц, затем 18 итд). Так узнаешь, какой порог слышимости у каждого уха. Если левое ухо слышит сильно меньше, чем правое (например левое 15к, правое 18к), значит ты его как-то подубил (например всю ночь стоял ухом к колонке на тусе или ещё где).

Вообще есть аудиометрия, но там, вроде как, больше 8кгц не измеряется, зато она покажет, есть ли у тебя проблемы с частотами до 8кцг.

А возможно это проблема с наушниками либо формой твоей головы/ушей, либо у тебя какой-нибудь отит.

10 Кб, 324x126

10 Кб, 324x126сап товарищи. Кароче суть проблемы,нужно сделать плейбэк динамичным по темпу,есть ли какой нить адекватный плагин,который как например регйлятор громкости в треке можно менять по ходу времени. Надо сделать постепенное увеличение,возврат в исходных,где то замедление и практически весь трек так. Я сделал 3 разных части по темпу,мелд,ср и быстр. соответственно,но мне теперь надо что бы переходы из темпа в темп были плавные. Я гипотетически могу взять шифтер или аналог,разбить переходы на части по 0.3 секунды и отредактировать все по этим частям,но уйдет на это у меня часа три. Это все равно,что редактировать громкость локальную таким же способом. Помогите,есть ли удобный плагин? Чтото типа пикрл,ток для темпа

Твоя DAW не умеет в автоматизацию темпа? Logic, например, позволяет автоматизировать темп точно так же, как и все остальное то есть плавно, кривыми, погугли, может и у тебя так можно

Ну я работаю в сонаре,там можно прямо ручками рисовать темп по треку,так же можно разбивать на транзиенты,определять темп дорожки,если ты его не знаешь,и редактировать путем растяжки/сжатия транзиентов. Я думаю в любом адекватном секвенсоре есть подобные функции.

не уж то аудишн неадекватный.а в секвенсоре в принципе тоже можно сделать,но я еще не разбирался как.попробую

Так он на макс громкости тихий, и как бы громкость прямое влияние на человека оказывает, чем громче тем пизже кажется.

А если нет варианта басы делать тише? Вообще часто сталкиваюсь с тем, что некоторые мои треки тихие, в смысле лимитером когда поднимаешь общую громкость, уже появляются искажения, но громокость не поднялась до нужного мне значения.

многополосную компрессию юзаешь при этом?она может решить искажения убрав пики определеных частот и в целом плотность создать, после этого лимитером поднимаешь

И с ней и без неё делал, не особо разница была, я возможно в какой-то фундаментальной штуке проёбываюсь при сведение или аранжировке.

что делать, если я, просмотрев уроки по сведению(компрессия, ревербация и т.д.) большинство объяснений не смог понять

есть ли какие-то общие правила по настройке, например, компрессора на акустическую гитару, или на барабаны, или ещё что-то

я заебался уже в край сук

Нахуя тебе это? Открывай компрессор и крути ручки, пока не получишь нужный звук, со временем запомнишь, что именно нужно крутить.

Компрессор это просто автоматизация громкости. Можешь даже сам вручную автоматизацию прописать.

Несовсем.

Посмотри от викисаунд, там годно объясняется и с примерами хорошими без всякой лишней залупы.

47 Кб, 480x659

47 Кб, 480x659может как то это можно адекватно отрегулировать уже в вав формате и уже в аудишене? какой нибудь вст приблудой,мне надо что бы инструменты все строили в 442

уже понял,полезная функция очень. адекватный вст питчер не подскажешь?

https://vimeo.com/33583707

Запись музыканта за работой, как источник вдохновения и тыринга фишек.

Видеокурс Джона Олина.

Гармоники не бывают широкие или узкие, у них только частота, амплитуда и фаза. Резать ничего не нужно, кроме устранения линейных искажений микрофона, если они заметны. Никакой потребности в имитации какого-то "легендарного" древнего говна нет, поэтому пользоваться компрессорами, графический интерфейс которых похож на что-то старинное не нужно, это плохие компрессоры, они делают из расчета на тех, кто любит что-то воображать о "винтажном звуке". Стрелочки.

Если нужно добавить нелинейные искажения, для этого найдутся отдельные плагины, искажения у которых приятны. Существуют очень гибкие, например, у melda, чуть ли не напрямую контролируются какие должны гармоники и где возникать. Это если уж прям так нужно. Есть decapitator для тех, кто любит воображать винтаж. А можешь Boz Rack Spacer ебануть.

Делаю тестовое задание, тв-продакшн, несколько сцен из мувика, в сумме - 10 минут. Результат: -24 ЛУФС, -14 ММЛУФС, -3 ДБТП, 11.8 ДД. Это прокатит?

Хз как на ебу найти эти рекомендации. У них одна там всякая хуйня бесконечным потоком льется, потому что они изображают бурную деятельность.

https://tech.ebu.ch/docs/r/R128s1_2014_RUS.pdf

https://www.youtube.com/watch?v=8ej973yI9co

Блин, ну возьми анализатор и посмотри. По сути, убираешь все, кроме частот, окружающих 200-250 герц.

Смотришь на "коммерческие миксы", там всё ровненько. Играет бочка+бас, смотришь на анализаторе, ачх вообще не изменяется, как нарисованная. Как так делают? ... ну я в курсе, компрессия, эквализация, сайдчейн, но, у меня всё-равно всё прыгает сильно. Может, есть какие-нибудь более толковые уроки, чем просто начальные.

зы - Я не могу найти совета нигде, сам искал... запарился конкретно.

Так я и говорю, у меня там пустота, чем заполнить - хз. Ещё один бас что-ли? Так по-задумке не нужен.

Слушаешь другие миксы, с синусоидным басом, всё заполнено, и ничего не скачет. Как так сделано - хз.

Раскрою мысль, чтобы не ныл. Слушай только, сравнивай с референсами, с реальными звуками, слушай на мониках, на шитконтроле, в наушниках, слушай, а не смотри ни на анализаторы, ни на какие-либо еще графические элементы. И тогда у тебя само все встанет туда куда надо. надо будет 150-300 чебы не пусто было, то и не будет. Вот увидишь.

Общие фразы вконтактные какие-то.

Дай демку послушать, может, скажу в чём конкретно дело.

А то у тебя общий вопрос какой-то вконтактный. И ответ на него - лоускилл или отсуствие опыта.

150-300 район гармоник баса и "тела" ритм- секции, то бишь, гитар всяких или пэдов.

221 Кб, 1882x1006

221 Кб, 1882x1006>>601455

P.S. Так что всегда есть чем заполнить. Я ещё в 90 процентах своих миксов посылаю малый в aux, где поднимаю красящим eq как раз район твоих частот, чтобы долбило как следует, компрессирую 76-ым с минимальной атакой и длинным релизом, затем удлиняю транзиент транзиент десигнером (извиняюсь за тавтологию), выбираю плейт с миксом на 20-30% (длина реверба зависит от темпа песни), получившийся звук очень аккуратно подмешиваю к основному малому, вследствие чего получаю уплотнённое звучание малого и общий подъем по рмс. Можешь попробовать.

Как бы банальны ни были мои слова, но универсального рецепта нет. Baby steps.

Эту aux дорожку желательно автоматизировать: в куплетах и барабанных сбивках потише, в припеве и мясных частях песни погромче.

2,9 Мб, mp3

2,9 Мб, mp3Купил лампу

@

Вылезли все косяки звукоизвлечения

Там кроме медиатора много чего еще, если прислушаться. В транзистор/цифру было вообще не слышно. Я последние пол-года по сути переучиваюсь и ломаю устоявшиеся годами привычки - от этого медиаторного лязга хуй избавишься.

Клавиши отдельно от всего трэка. Как-то не в пространстве.

130 Кб, 3088x810

130 Кб, 3088x810Мы с тобой оба долбоёбы, %юзернейм%

Просидел джва часа в попытках избавиться от лязга - не смог повторить. Как только не пиздил струны - нету его. Сел разбираться с записью. Обнаружил, что лязгает не в момент атаки, а под самый конец (пикрелейтед, обведено красным).

Во-первых, это 1700Гц и прекрасно вырезается эквалайзером.

Во-вторых - это не медиатор. Это струны задевают звукосниматель, когда на них падает кисть правой руки. Пиздец. Пойду высоту звучков регулировать.

оу, спасибо. Интресно.

Топы с Кэлвинами Харрисами, Дипло и т.п. как-то не интересны. Или, неужели, они и есть у всех ориентиры?

Alon mor, rawtekk, продукция лейблов interval audio, ignite rec и вот это всё, Всяких vorso, kursa, kurve, audeka.

Электроника не жанр, нужно слушать то, что хочется делать, это ж рефы.

Нахуй дипло, лучше уж послушать дедмауса, у его музыки есть что-то универсальное, что можно почерпнуть. гармонии, саунддизайн на кончиках пальцев

Он много на чём, на самом деле, пшто универсальный солдат.

С серумом такие выкрутасы вытворяет, стоит даже стримы глянуть.

Звук не может быть старым. Может быть какая-нибудь винтажная задумка, но звук универсален. Вся индустрия занята придумыванием способов интереснее загадить звук.

Тот же Маус, например, принимал участие в создании Серума, и активно его использует. У него невероятно дорогая студия, да, но это не значит, что он не использует цифровые средства.

Звук у него конечно классный, но, он более близок к прямому аналоговому звуку, классика в общем.

Так-то согласен, кто на что горазд, и даже на старом железе умудряются офигенной звучание замутить.

Меня больше какие-то новые идеи интересуют. Я думал, может что-то пропустил интересное.

Щас мутантфанк ну и неограйм всякий, деконстракт клаб крч и халфстеп поднимаются вывод сделан на основе того что всё больше тех кто делали раньше глитчхоп всякий и бейс музыку в других направлениях сейчас делают халфу, mindex, sixis и прочие. там новый саунд, эксперименты и фьюче мюзик.

Как-будто халва не имеет отношения к глитчу или басовой музыке, лель.

Я бы сказал, все сейчас делают эксперименты на грани соединения поджанров днб, дубстепа и футурового хип-хопа и другой битсовой музыки.

Попадаешь.

Как сводить - сайдчейнить все к кику, возможно, даже к снеру.

Когда сайдчейнишь, если релиз компрессора сделать совпадающим с темпом трека (посчитать миллисекунды можно тут: http://www.sengpielaudio.com/calculator-bpmtempotime.htm), то будет хорошо держаться ритм.

Но можно не заебываться с рассчетом сайдчейна, а просто сделать автоматизацию громкости под каждый кик в нужном размере. Так еще будет моментальная атака, в компрессоре может быть миллисекундная задержка, если это тебе важно. Просто поэкспериментировать может быть интересно.

Обрати внимание на динамику в первом треке, который ты линканул - там все раздавлено компрессором, и за счет этого воспринимается громче. Превьюха в саундклауде, конечно, это такой себе ориентир, но все равно, в твоем треке видно транзиенты от ударных, можно поднять уровень всего остального по отношению к ним, и будет восприниматься, как более громкий трек.

136 Кб, 610x420

136 Кб, 610x420Есть такая хуйня, называется Crest Factor.

https://youtu.be/lk4D4bMu8uo

А то сразу мультибанд компрессорами лезут шатать.

1,3 Мб, 3024x4032

1,3 Мб, 3024x4032>что делать, если я, просмотрев уроки по сведению(компрессия, ревербация и т.д.) большинство объяснений не смог понять

Смотреть и читать еще, пока не поймешь. Пробуй разные источники, один и тот же материал может быть по-разному в них изложен, это помогает понять тему лучше.

>есть ли какие-то общие правила по настройке, например, компрессора на акустическую гитару, или на барабаны, или ещё что-то

Есть, называются пресеты в твоей DAW, но использовать их для серьезного продакшена вряд ли получится, разве что для черновиков. Необязательно исходить из инструмента, над которым ты работаешь, как по мне, лучшая стратегия - это знать, что ты хочешь этим инструментом сделать. Другими словами, ты можешь гитарную партию обработать очень по-разному, в зависимости от того, хочешь ли ты, чтоб она была главной в миксе, или держалась на заднем плане.

145 Кб, 640x1138

145 Кб, 640x1138Audacity, если на винде, может записывать с loopback интерфейса - конкретное приложение не выберешь, но будет писать все, что идет на выход аудиокарты.

Еще на мак и винду есть всякие роутеры, которыми можно аудио отправить, куда надо, погугли, их не так много. Но оперативку и процессор очень жрут.

Неуверенные в себе сведунцы клянчат, позяластя можн сведу вам дорожечку посюсють чучуть компрессь жмяк жмяк бас бочечку сведу высокие дорожечки эквалайзером чучуууть.

А музыканты просто трепетно относятся к говну, которое высирают, дорожат говном, поэтому чсв возрастает.

Звукари - практикуются и набивают клиентскую базу, все же через сарафан делается.

Музыканты - ленивые мудаки, делающие все, чтобы не достичь успеха, в том числе - экономящие на всем подряд. Это естественное событие, найти своего музыканта, не жалеющего средств на хороший продукт - мечта каждого звукорежисера.

631 Кб, 2606x876

631 Кб, 2606x876>>603448

Собсна, у меня от совета использовать мультибанд компрессор так бомбануло, что я написал небольшой гайд, запощу его ниже.

Q: Хочу такие же громкие миксы, как у моего любимого экспериментального инди хип хоп квартета. Как?

A: Принимай во внимание соотношение пиков и самых тихих частей в твоем аудио.

Скажем, трек выглядит как пикрилейтед. Очень заметны транзиенты от ударных, в то время, как остальные дорожки постоянно держатся ниже.

Само по себе это не плохо, потому что у трека есть dynamic range, но как сделать из него вкусную сосиску, которая при этом нормально звучит? Сейчас это стало стандартом в индустрии, как бы кто к такому не относился.

Ответ - компрессия и лимитинг, но с умом. Если начать компрессить трек в таком виде, в котором он сейчас, транзиенты от ударных не дадут выжать из компрессора максимум, потому что они будут триггерить его раньше, чем он доберется до других частей трека.

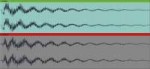

215 Кб, 2670x398

215 Кб, 2670x398"Ну так опусти трешхолд в компрессоре до уровня, на котором компрессор начнет влиять на другие части трека" - скажет особенно внимательный читатель. Это действительно превратит трек в сосиску, но в очень херово звучащую сосиску.

Красным отмечен трешхолд компрессора. Он действительно будет влиять на тихие части трека, и сделает их громче, если поднять gain, но что произойдет с ударными? Поскольку они намного выше, чем трешхолд, в лучшем случае, они начнут звучать плоско и безжизненно, в худшем получится пиздец уровня бас бустед мемов.

176 Кб, 2562x380

176 Кб, 2562x380Ответ? Уменьшить разницу между самыми громкими и самыми тихими частями трека перед тем, как компрессить и лимитировать его.

На скрине видно, насколько легче будет контролировать такую волну компрессором и лимитером - при этом в ней сохранена динамика, и ударные будут продолжать быть на первом плане, если это необходимо (в таких случаях сайдчейн - отличный помощник).

Кому интересен подобный контент вперемешку с мемасиками на музыкальную тематику, буду рад видеть на @audiomemery в телеге

96 Кб, 180x340

96 Кб, 180x340Как не испортить микс hipass фильтром

Казалось бы, какие неприятности может создать hipass фильтр? Обычно ведь его использование как раз наоборот ассоциируется с чисткой дорожек от нежелательного контента ниже определенной частоты. Хочу поделиться одной из проблем, которую можно заметить только ориентируясь на метры, другими словами, пресловутый совет "доверять своим ушам" тут не сработает.

Тем, кто использует семплы в своей музыке, наверняка известна техника создания ударных из нескольких слоев. Например, очень часто снер складывают из двух частей: нижней и верхней. В такой конфигурации в нижней части эквалайзером убирают верхние частоты, а в верхней - нижние, чтобы два семпла не наслаивались друг на друга слишком сильно.

К примеру, есть семпл снера, который пикует на -0.52:

137 Кб, 184x344

137 Кб, 184x344Допустим, мы бы хотели использовать его как верхнюю часть нашего двухслойного семпла. Соответственно, низкие частоты в данном семпле нам не нужны, потому что они будут взяты из другого семпла. Расчехляем эквазайзер и отрезаем все ниже, к примеру 130 Hz, смотрим на метр, и, внезапно, видим клиппинг:

518 Кб, 2152x994

518 Кб, 2152x994При этом сам семпл может начать звучать даже тише, что контринтуитивно, поскольку фактически его пик поднялся на два с небольшим db. Почему так происходит? Фильтр изменяет структуру волны, и ее амплитуду включительно. Сверху - оригинальный семпл снера, снизу - с hipass фильтром на 130 Hz:

На скриншоте видно, что изменилась даже фаза волны. Это, кстати, тоже может повлиять на качество слоеного семпла, но фаза - это тема для отдельного поста.

Такая проблема может возникнуть при использовании hipass фильтра на транзиентах. Транзиент - это звук с быстрой атакой и (в большинстве случаев) быстрым релизом. Провести смычком по струнам скрипки - не транзиент, поскольку у данного звука длинная атака. С другой стороны, игра на той же скрипке с помощью техники пиццикато вполне подпадает под определение транзиента. Звуки, которые издают перкуссионные инструменты - также транзиенты.

70 Кб, 604x610

70 Кб, 604x610Почему все вышеперечисленное может быть важно? Такой некотролируемый пик в треке съедает headroom, а headroom важен для мастеринга и того, насколько громко будет звучать финальный трек, а громкость в 2018 это чуть ли не основной параметр оценки качества мейнстримной музыки.

Как этого избежать?

-использовать более пологие фильтры, если в эквалайзере есть такая настройка

-срезать от частоты повыше, но от этого звук может стать тонким и хлипким

-контролировать пики компрессором с быстрой атакой; в данном случае нужно быть внимательным, чтоб полностью не задавить транзиенты

-лучший вариант, как по мне - использовать другой семпл, в котором изначально нет ненужных частот

-еще неплохой вариант - просто сделать семпл тише, вы можете обнаружить, что больше ничего и не надо было.

По адресу на пике регулярно будет больше подобного контента.

У меня был, англоязычный, но со временем я на него забил, потому что делать видео намного более трудоемкая работа, чем писать посты. Плюс, в англоязычном интернете таких туториалов достаточно, а, судя по тому, что я видел в рунете, у нас такого как раз не хватает. Вкатывайся в телегу, если интересно.

>делать видео намного более трудоемкая работа

Имел ввиду, что не хватало времени и сил, а не что мне было влом.

Блин, а звучат нормально. Прикол. Тут потеешь всё чего-то, и хз зачем)

Вообще годно пишешь, продолжай. И сюда дублируй (как сейчас), а то в телеге затеряться могут среди сотен подписок

Таков план, правда, думаю в разные тхреды постить, в зависимости от тематики поста.

59 Кб, 480x640

59 Кб, 480x640Не знаю насчет ценности в определении частот на слух. Если эта способность не встроена в знание музтеории, то особого толку в том, что ты можешь распознать на слух, как звучит, скажем, 260 Гц, нету. А вот, если ты знаешь, что 260 Гц - это middle C, это совсем другое дело. Веду к тому, что учиться распознавать лучше ноты.

Посему, рекомендую отличный бесплатный сайт для тренировки слуха (промотать вниз страницы к разделу EAR TRAINING):

https://www.musictheory.net/exercises

Сложность всех упражнений можно настраивать, 10-20 минут в день хотя бы две недели ощутимо улучшат способность различать типы аккордов, интервалы, и индивидуальные ноты (проверено на себе).

Пригодится музыкантам, продюссерам, певцам, аудио инженерам, да и вообще всем, кто хочет отсрочить свой Альцгеймер, но не имеет музыкального инструмента.

Подобную инфу регулярно пощу на канале на пикрилейтеде, присоединяйтесь.

Спасибо.

149 Кб, 640x642

149 Кб, 640x642Rhythm Roulette поищи на ютубе.

Положим, так: есть трек, на нём маленький отрезок с изменённой громкостью. Можно отследить границы этого отрезка, но невозможно отследить, как была изменена громкость, стала ли больше, меньше, и на сколько.

Нужно вернуть в исходную громкость этот отрезок (или внешнюю часть подогнать под него). Как называется это действие, и как его осуществить, например, в Audacity? То есть так: выделить отрезок, и где-нибудь какой-нибудь ползунок подёргать, чтобы сделать громче/тише, и чтобы даже визуально волны растягивались на отрезке (чтобы можно было визуально подогнать под границы).

Кнопки чтобы сделать "как было" нет, если действие не было совершенно вот непосредственно в твоем проекте в этой программе. Выдели кусок и подгони его гейн к остальному, больше ничего особо не придумаешь. Ну, это если без деталей, т.к. хрен поймешь что там у тебя за отрезок чего и что конкретно ты хочешь с ним сделать.

Как правило - выделить кусочек, найти в инструментах "Гейн" и поднять или опустить его.

Я запускаю в audacity оба, ищу какой-нибудь хороший пик. Потом использую формулу: 20*lg(a/b), и так нахожу сколько дБ нужно добавить к более тихой, чтобы получить более громкую. Но блять сука нихуя не выходит.

Проблема в том, что я не понимаю, что это за шкалы от -1 до 1 и от 0 и вниз в отрицательные значения (осциллограмма). В чём между ними связь, в каких величинах они измеряются, как соотносятся. То есть я не знаю, какой именно параметр в каких единицах измерения я нахожу по своему пику. Гугление совсем не помогает, я уже весь бля извёлся и изматерился от неспособности найти понятное объяснение, чем в audacity отличаются эти шкалы, что на них, что такое дБ и как найти точную формулу перевода одного пика в другой.

Помогите, пожалуйста.

Мудила, блеать :3 я любя, подгони громкость по уху, никогда ты два фрагментам по приборам не выровняешь. И пока ты продолжаешь писать про какие-то абстрактные "фрагменты", не указывая ни их длину, ни содержание, ни, что главное - задачу - зачем тебе все это нужно, что конкретно ты делаешь - никто тебе ничего не скажет, т.к. все приемы, помимо простейших - напрямую зависят от твоей задачи.

А если тебя интересует инстурментарий аудасити, что какая ручка делает - иди читай мануал, там лучше написано, чем любой тут ответит.

Тебе нужно подогнать RMS одного трека к другому. Ну, либо пики дБ, но это подгонит только тренсиенты, perceived volume это не поднимет

>Цель: усилить более тихий трек так, чтобы он стал идентичен более громкому.

Так поднимай RMS, что ж ты мозги ебешь формулами, величинами и осциллограммами?

Он спрашивает, какую ручку ему нажать, чтобы сделать громче. Ты думаешь, фраза "Поднимай РМС" ему о чем-то скажет? Или ты в курсе, что у него за материал там, и можешь сходу, не слушав, сказать, как поднять РМС? Предложишь ему лимитера добавить, или сразу десяток решений, на случай, если жать уже некуда? Я вот не ебу, что у него за шкала от -1 до 1, но от нуля вниз-то понятно, что дбфс - а он и этого определить не может, и "гугл не помогает". Зато логарифмы какие-то накручивает, высчитывает что-то.

Вот он сейчас выровняет РМС, а у него эти два куска окажутся двумя атмоферами с совершенно разными текстурами и огромными пиками в разных участках спектра. РМС будет ровным, но звучать ровно это не будет ни для одного уха на планете.

Начинать надо не с дроча показаний приборов, а изучения динамической обработки и применения ее для подгонки по слуху, результат которой надо проверить на нескольких системах в разных помещениях. Собственно, всё. Потом с удивлением обнаруживается, что и по цифрам у тебя все в пределах допустимых колебаний. Приборы - они для подтверждения результатов, или уточнения источника проблемы, это продолжение твоих ушей, а не замена оных.

Ну это уже из разряда "гыгы ребята как зделать так громче и шоб долбило))0".

Зачем же в резонерство и схоластику пускаешься со своими философскими мыслями, просто посоветуй ему курить мат. часть.

Спасибо!

0 философии же. "Кури матчасть" это такая же абстрактная хуйня, как "подними РМС". Т.е. всё равно что нахуй послать. А так у него есть прямо вот инструкция, хоть и написаная чсвшным мудаком с двача. Большая часть начинающих просто не знает, с чего, собственно, начинать, в этом и проблема.

Громкость звука - это субъективная вещь и для человека она измеряется по какому-нибудь стандарту и для этого есть отдельные измерительные шняги.

https://www.kvraudio.com/product/ac_r128_by_audiocation

-1 до 1 - это линейная шкала амплитуды. 1 и -1 - это 0db. -10 db - это 0.1 и -0.1. -20 db - это 0.01 и -0.01. -90 db - это 0.000000001 и -0.000000001. 0 - это -бесконечность db.

>-1 до 1 - это линейная шкала амплитуды

Зависимость количества децибел от точки на осциллограмме не линейная, а логарифмическая.

>-10 db - это 0.1 и -0.1. -20 db - это 0.01 и -0.01

Нет, это будет 0.316 и 0.1 соответственно.

>>605129

Пики точеные в децибелы дроченые перевести очень легко - по формуле 20log(x), где x это число, обозначающее, во сколько раз значение точки на осциллограмме меньше единицы. Допустим, у тебя пик на +0,628. 1/0,628 = 1,592. Подставляем в формулу 20log(1.592) = 4.03, т.е уровень сигнала в этой точке равен -4.03 дб.

10 Кб, 347x670

10 Кб, 347x670В аудасити есть переключение шкал, одна из них линейная, другая логарифмическая.

Насчет 0.316 правильно, я перепутал с залупками.

>В аудасити есть переключение шкал, одна из них линейная, другая логарифмическая

Ну тогда ладно.

И, кстати, эта шкала тоже не линейная, а логарифмическая, просто формула не 20log(x), а 10log(x)

21 Кб, 252x869

21 Кб, 252x869Во, хорошо, можно на примере.

Пик 1 = 0,49. 20log(1/0,49) = -6.2db (Или 10log(1/0.49) = -3.1db)

Пик 2 = 0,35. 20log(1/0.35) = -9.2db (или 10log(1/0.35) = -4.6db)

Только нахуй вообще это нужно, я так и не понял. Два одинаковых трека с разной громкостью, вычислять пики в децибелах, вообще охуеть.

Там можно переключить на логарифмическую шкалу. Это ничего не важно.

Я челу скинул ссылку на бесплатный измеритель LUFS.

Если тебе при этом приятно звучит при всех вариантах прослушивания - да. В электронике и больше может жать с кика-снейра. Проль вообще молодец в этом плане.

Если можно, дайте ссылку на скачивание.

Если можно, дайте ссылку на скачивание.

Нужно сначала узнать, где живет Эхо, придти к нему и ебало набить, за то, что дразнится.

Реверберацию чистит unveil и izotope rx. Скорей всего ничего удалить не получится. Неизвестно вообще что у тебя за трабла, потому что ты не даешь сам звук, а просто своими словами описываешь ее. Эхо, блять. Эхо.

Скорее всего речь про делэй. Эхо это тащем-то конкретный звуковой эффект, а вот чем его получили - другой вопрос.

Нужны рекомендации от общих до вполне конкретных, как сие сводить и располагать в пространстве теже гитарки, фанно, саксы ибо они практически на одной частоте, при помощи каких приемов (помимо эквализации), что с компрессией? По ударке понятно - параллельная, по остальному нет, какие комнаты, что с дилеями? Если впадлу писать скиньте сурс где почитать, это очень ВАЖНО, всю жизнь сводил электронику, а освоить живяк очень охото, спасибо!

сводить не сложно, сложно понять как оно на самом деле должно быть. а это сложнее, чем написать хорошую музыку и не сводить вовсе

Я бы сказал, сложно найти баланс между вещами, которые ты действительно можешь сделать сейчас и идеальными вариантами, дабы работать и развиваться, а не месяцами пересводить одну и ту же композицию. Как оно "должно быть" понять не сложно, есть же референсы. Но "как должно быть", "как тебе нравится", "как ты можешь" (в контексте, банально, имеющихся в запасе приёмов, понимания инструментария профессии) и "как хочет клиент" - как правило, четыре отдельных мира.

Сведи как фанковую электронику. Ты просишь придумать за тебя всю звуковую картину. Если ты хочешь откуда-нибудь все скопировать - ну, послушай какого-нибудь похожего по задумке фанка, скопируй. Принципы все те же, ты ведь сводишь в коробке - не слишком широко, не слишком узко, низы уже середины, середина уже верха. Да, параллельная в джаз-фанке звучит диковато, я бы пошел с сатурейшн-шиной, в которую послал бы по чуть-чуть почти всю ударку и часть гармонических инструментов. "Что с компрессией" зависит от того, "что с сигналом". Главное правило Джаза - инструменты должны говорить друг с другом, отвечать друг другу на фразы. Постарайся проникнуться драматургией композиции, и стерео-позиции для каждого акцента сами найдут тебя.

Нуждаюсь в сведении трека, жанр где-то на перепутье лоу-фая и пост пунка

так же нужно свести несколько битов

@mydlann тг забыл запилить

1,2 Мб, mp3

1,2 Мб, mp3Можно отрезать самый низ, после сотки, и самый верх, аккуратно найдя правильный угол среза в районе 10к. В остальном, если у тебя ничего кроме них не звучит - ничего трогать скорее всего не стоит. Правда, два инструмента - такая себе аранжировка, если уж прямо.

Сейчас в аккомпанирующей гитаре почти нет серединки, все давят ее басы, плюс щелчки сверху. Большая часть людей не сочтет это красивым. Рекомендую поиграть с реверберацией и стерео-позициями для обеих гитар, подыскать состояния, в которых оба инстурмента доносили бы свой полезный материал лучше всего, и без лишней эквализации, и потом уже - аккуратно подпилить неприятные резонансы, вроде 1к или 7к.

Если тебе главное звучание, звучит нормально. Я не знаю как эквализировать гитару, как и всё остальное наверное. Обычно эквалайзером все что плохо звучит фильтрую. Вот и вся эквализация.

Отрезать весь низ до самой низкой ноты. В твоем случае можно даже прям фильтром и по верхам пройтись, ну или конкретно так задавить их. Вообще, тут чисто по вкусу же. Можешь взять какой-нибудь референс с похожими гитарками и по нему эквализировать. Можешь заюзать читы, как в видосе вот этом, если вообще ничего не знаешь и не понимаешь:

https://www.youtube.com/watch?v=WwhcL0BRyNs

Он там на примере митола показывает, но принцип тот же.

Компрессор бы не помешал, очень уж "волосато". Если умеешь ровно играть, можешь дабл-треков записать. Реверка набросить не мешало бы. Панорамировать это всё дело.

А, ну и главное, у тебя там жужжит что-то пиздец. В первую очередь с этим разберись.

Цепь у него жужжит. Но не гейтовать же ему акустическую гитару, говно получится.

>>611917

Это конкурс методических разработок, работаю в музыкальной школе. Так что оркестровых партитур или всяких современных штук с синтами и барабанами там не поймут. Всё максимально академично. Пьеса для двух гитар, в джазовом стиле, переложение стандарта Lullaby of Birdland пианиста Джорджа Ширигнга.

>>стерео-позициями для обеих гитар

Имеешь ввиду панормирование? Например, одну гитару на 20% влево, другую на 20% вправо? Или побольше принято делать?

Спасибо за советы, сейчас буду пробовать. Если бы ещё уроки не мешали, было бы совсем хорошо. Я прямо на работе хуячу, аврал же, бля, до субботы надо сдать

Ну, можешь еще фазу покрутить, если захочется. Принято - "не слишком широко". Покопайся, поймешь сам, ты же тем более, выходит, педагог, слушать умеешь. Должно создаваться ощущение, если закрыть глаза, лел что перед тобой - сцена, и сидят два гитариста. Если по твоему замыслу они сидят в разных углах - ну, сделай так. Но скорее всего они будут сидеть чуть-чуть по сторонам в центре. Разводи, пока не будет приятно и удобно. Можно заморочиться и поиграть с пространством, задвинув их глубже в сцену, через размытие реверберацией и сокращение эффективного спектра по краям. Персонально, я бы сказал, что ДОЛЖЕН ощущаться центр, сильно разведенные инстрменты - как правило, звучат неестественно относительно друг друга, разве что идут в один моно-ревербератор, например.

Ну или просто проверь, не ломается ли все к хуям, когда слушаешь в моно.

Спасибо тоже, не сразу увидел ответ... Нет времени читать гайды и мануалы, к сожалению, надо сделать быстро. В дальнейшем обязательно посмотрю

70 на 70 раньше делал, сейчас делаю 100 на 100, так сказать по забугорному

За сегодня успел кое-как записать первую гитару, записывал кусочками, играл кривовато, но зато готова вся партия целиком. Убирал низкие, высокие, добавлял ревер... Ещё нашёл такую штуку - компрессор-эквалайзер, как я понял, он компрессирует отдельные полосы частот, потыкал его тоже, оставил... Пока заметил такую штуку - на бытовой акустике звучит приемлемо (у меня в классе старый музыкальный центр подключен к компу в качестве колонок, лол, на нём ещё кассетные деки есть и сами колонки четырёхполосные с йоба-сабвуфером), а когда слушаю в плеере на дрянных затычках philips - пропадают напрочь низкие и лезут противные призвуки от струн, ногтей, ладов. В общем, буду делать, спасибо за помощь, как будет готово - вброшу в тред на оценку.

Что нужно, чтобы этого не было? У меня сейчас так - гитара Godin la Patrie с пьезозвукоснимателем, пульт Behringer 12 канальный, из пульта через tape out идёт сигнал в компьютер, в линейный вход на материнской плате

Пульт бы сменить на вменяемый аудио-интерфейс, это совершенно не нужный в цепи элемент, и, видимо, выполняет в ней задачу питания для пьезы.

>>611956

Если ты хочешь меньше призвуков атаки - рекомендую снять себя микрофоном, или подыскать другой сниматель\инструмент, адекватно и красиво задвинуть их не получится. У тебя вообще мало что получится сделать в плане продакшена в коробке, т.к. живой акустический сигнал, все твои действия будут его только ухудшать, и вся органика проебется. Наиболее важным для тебя является этап снятия, собственно, звука - если есть возможность, микрофонная пара, одна фронтально в деку, одна - ~45 градусов к струнам на грифе, получишь отдельно суть, отдельно - атаки, и миксуй их между собой как хочешь. Компрессию не рекомендую (ну может разве что сосвсем-совсем чуть-чуть), убьешь свою "живую" динамику, академические точно не поймут такой хуйни.

6,1 Мб, mp3

6,1 Мб, mp3>>611963

Для питания в гитаре есть батарейка, так что пульт совсем не нужен. Но у меня из кабелей был только инструментальный, с большими джеками, и RCA на маленький джек, так что без пульта не подключиться вообще. Вот такой пиздец. А уж про снятие двумя микрофонами я пока и не мечтаю, есть правда какие-то караочные в школе, но ни одной живой стойки для них даже. Я ж этим не занимался. Но кстати мне понравилось, так что буду думать про аудиоинтефейс и всё остальное. Ещё не раз приду спрашивать совета, лол. Пока что подписался на тред, всем добра

На мой вкус, еще бы чуть поуже их. Есть кстати интересный прием, где ты делаешь сенд с разведенных инструментов на один канал, сворачиваешь в моно и убиваешь по частотам, прежде чем подмешать к общему ревербу, дабы у тебя четко сохранялся центр при сильной панораме.

В лид-гитаре можно срезать верх при записи, и насытить пост-фактум, чтобы как-то скрасить атаки. Но в целом все норм.

>vst vitalizer mk2-t

На ньюсах и рутрекере есть. Только нахуй он нужен

Там только стерео кнопка норм, а остальное кал.

Железный вроде ещё окрашивает и фазу крутит интересно, но на плагине это плохо реализовано

Двачую, ггг.

109 Кб, 800x800

109 Кб, 800x800Куда вы его панируете?

Пишу трэп, фонк, всегда делаю направо на 10 (Ableton)

Недавно нашел "сведение-грамму" и еще несколько, везде хэт слева. Есть ли большая разница вообще? Как вы делаете?

113 Кб, 1038x698

113 Кб, 1038x698Это важно лишь для живых удрарных, так как для них существует 2 перспективы (ну джазовую не в счёт): со стороны барабанщика и со стороны слушателей.

Для электронных хай хэтов типо 808 как хочешь панаромируй, так как они не существуют в реале. Часто справа на 14:00 ставят хэт судя по многим трекам, но кому-то и слева нравится

Хэт "под установку" в электронной музыке - дно, т.к. твой хэт ебашит почти одним саундом, огромное, бессчетное количество раз. Хэт надо либо панорамировать динамически, водя под каждый акцент в разные стороны, либо делать что-то похожее через делэй, либо, самый сок - разделить партию на несколько хэтов с чуть-чуть разными характеристиками, и развести их в разные стороны, сдобрив единым ревербератором. Или другой высокой перкуссией, короче, сбалансировать адовый покот чопанных высоких частот, которые ты решил задвинуть в угол - похожим потоком высоких частот в противоположном углу.

Если же ты прямо "имитируешь ударную установку", и тебе это принципиально - да, уводи влево, справа его слышит только ударник.

А где про все это прочитать? Вот эти все сенды с сатурацией и панорамирование неживых инструментов. И полюбому ведь тысяча таких фишек есть. Откуда вообще берут подобного рода инфу? Вот книгу по сведению прочитал, но там только общая инфа. В курсах в интернете тоже в принципе.

70 Кб, 621x621

70 Кб, 621x621https://yadi.sk/d/hh_FVoC6OjOp5g

https://yadi.sk/d/Mrm2dvig4kKZAQ

https://yadi.sk/d/3KecabT9A7Zd_w

https://yadi.sk/d/fuBrpYmw-5LUSg

(да, сэмпл из карлсона, Merv Griffin - House of Horrors)

То есть все на своем опыте?

Следует сразу понять одно. Звукорежиссура - не химия, тут нет рецептов с точными формулами. "Правила" существуют, но заключаются прежде всего в понимании основных свойств звука, и соответственно, дают тебе не точные инструкции "что делать", а подсказывают поле, в котором следует искать решение. Например, мы слышим, что два инструмента дают на конфликте неприятный звук, и идентифицируем его как фазовое искажение. Соответственно, мы знаем, что можем применить один из тысяч способов хитрой ебли с фазой, или и вовсе, сместить один из звуков на 5-10 мс - но нет "священной книги", предписывающей поступать конкретным образом и утверждающей, что так будет "лучше".

Если твоя звуковая картина про передачу записанных инструментов - там "лучше" = ближе к источнику. В электронных вещах, не имеющих прямых референсов из "реального" мира, "лучше" = ближе к замыслу звукорежиссера. В итоге, работа с каждым звуком будет сводиться к вопросу "зачем этот звук здесь нужен", и все, что мы с ним делаем, должно работать на подчеркивание этой задачи. Каким же конкретно образом ты добился того или иного звучания, в конечном итоге, вообще никого не трогает - главное, работает ли.

Иными словами, да, экспериментируй больше. Можно красть чужие приемы и пытаться адаптировать их под свой материал и свои замыслы, но лучше красть прямо общие "идеи" а не конкретные примеры исполнения.

Т.е. например "распределить хэт в пространстве" - задача, решаемая тысячей разных способов, каждый из них будет звучать уникально и интересно, и хуй знает, какой подойдет тебе лучше. Попробуй все подряд?

Опыт вроде и большой, но в как таковом сведении его не так много. Поэтому буду раз в день что-то сводить, надо набить опыт именно здесь. тест трип кода

Сквозь время и пространство. какие же противные искажение во фрукте, однако. Хер с ним с дисторшеном на средне-высоких на хетах, сам звук какой-то ущербный получился. Переучиваюсь потихоньку.

Круто свёл, но слышен алиасинг, возможно т.к ты работал в 44.1, а там говнится звук. Но услышать это очень тяжело. посты старые, всё равно всем похуй на ответы уже, остальное не буду коментить

Приехали. Фрукты выгодны в первую очередь отсутствием искажений на экспорте. Сравни, например, с Аблой.

Вариант "фрукт" ты как-будто специально пытался сделать настолько плохо, насколько это возможно, лол.

Только если висит на канале что-то одно или совсем по чуть-чуть. Если же мутить обработку длинными цепями то всё, можно хоронить звук, особенно если он уже финальный и вроде бы готовый: на выходе он полюбому будет уничтожен. А его-то всё равно надо обрабатывать чтобы посадить в микс. Работал в рипере как обычно, и поставил его недавно, а результат настолько чище и нет этих непонятных искажений. Всё чисто, ровно.

Может быть промежуточная обработка во фрукте создаёт алиасинг на каждом этапе по чуть чуть, а потом его становится больше, но совсем незаметно на слух первоначально? Как это запруфать я не знаю.

Недавно перенёс один сложный презет с фрукта на рипер, его суть в дублировании одного и того же сигнала. Так вот, во фрукте он уговнён по максимуму, из-за алиасинга непонятно откуда берущегося, а в рипере - чист. Просто потому что он не генерирует говна в звук, я не специально так извращался чтоб уговнить фруктовую версию, я работаю так _всегда_. И решил поставить рипер. Но вот когда закончил в рипере делать и послушал фруктовую версию, уже решил забить на ударку где дисторшен на верхах и вбросить так. Просто в сравнении с остальным звуком при работе этот дисторшен не настолько бросался в замыленые уши. Это же как должно всё уговниться чтобы в итоге не был слышен дисторшен на ударке при сведении, сведении, где я не кидаю дисторшен никуда специально? я может и ебанутый, но дисторшен кидать на ударку на мастер? Алсо, этот ебаный дисторшен отчётливо слышен у других но его слышу только я(?), как мне его отдельно выдавить?, если послушать мой пример из рипера и часть примеров из треда. Откуда он берётся? Сто процентов большинство вброшенного было запилено во фрукте и это не вина тех кто пилил.

tl;dr

подскажите, пожалуйста

>soundgym

Не знаю что это за хуйня, но можешь пробовать делать так - берёшь acon defilter, zynaptiq unfilter, создаёшь там отпимальные презеты выравнивающие звук. И пытаешься делать также как эти плагины, но без этих плагинов. Смотришь как они ровняют твою любимую музыку, пытаешься въехать что именно происходит.

Но если гуглить аналоги soundgym то на реддите выдаст вот эту приложуху

http://harmanhowtolisten.blogspot.com/

или сразу ссылка на эту хуйню

https://drive.google.com/file/d/0B97zTRsdcJTfNWEyNzhhOTctYTk2ZC00NDI2LWFlMmQtZmEyNjExNjE3MWI3/view?sort=name&layout=list&num=50

Какие-то искажения, которые только ты слышишь при сравнении двух разных треков с разным сведением, ты объясняешь процессами, которые называшь "промежуточная обработка, создающая алиасинг". Это не круто.

Все DAW работают в числах с плавающей точкой, вплоть до расширенной точности, никаких ошибок округления быть не может ни в какой DAW. Все операции транспонирования готового аудио производятся с избыточным качеством интерполяции. Во всех DAW избыточно. В FL интерполяция сверхизбыточная, вплоть до 512 point sinc и она добавлена только ради успокоения гуманитариев. То есть манипуляции с аудио исключают алиасинг . Все синтезаторы и эффекты генерируют звук так, как хотят разработчики этих синтезаторов и эффектов, DAW не могут менять код в dll. Алиасинг от сторонних синтезаторов и эффектов, когда есть, то он везде один и тот же.

Вероятнее всего он как раз и наубивал себе цепь, пользуясь разными вещами, плохо подогнанными друг к другу. Я как-то очень долго не мог понять в одном треке, почему у меня 808 иногда теряет базу, оставляя только верхние гармоники, крутил патч, баунсил-ребаунсил, эффект возникал "рандомно" в разных частях композиции. Естественно, дело было всего-лишь в хуево настроенном под текстуру лимитере в начале цепи.

А вообще, да, придумывать себе "алиасинг" - любимое развлечение свежевкатывающихся. Как и попытка выбрать DAW, ориентируясь на какие-то "технические аспекты", окромя собственно удобства рабочего процесса, и иногда - наличия или отсутствия некоторых функций. Редактировать звук в видео я бы в ФЛ точно не стал, например - но исключительно из-за подразумевающегося рабочего процесса.

Я вообще никак не объясняю, а задаю вопрос в пустоту(?)

Раньше работал в 44.1, типа нинужно, для гуманитариев всё что лучше 44.1, все хуесосы а я вот умный долбоёб, уж я-то знаю, я же элита, я технарь. А это всё от советсткой пропаганды пошло, прошилось всем в мозги.

Практика - главный критерий истины, вот на практике почему-то получается дисторшен, я не знаю откуда, и вот именно я слышу в данном случае это замечательно, на примерах сведения других в данном треде, и своего собственного.

Сначала сделай абсолютно идентичные операции в двух программах, все обработай одинаково, каждый параметр. Не пропусти ни одного. Если аудио где-то растягиваешь, то сделай настройки качества интерполяции в обеих прожках аналогичные. Потом оба образца сравни в программе lacinato abx, так как там написано, не менее 15 пропыток. Тогда это будет практическая проверка того, что все прожки работают так, как документировано.

Бывают экзотические DAW, у которых в микшере имитируется аналоговая говнистость. Т.н. "продвинутые алгоритмы микширования". В остальных DAW микширование это операция += .

>Потом оба образца сравни в программе lacinato abx

Это будет практическая проверка того как ты проходишь слепые тесты, а не того что

>прожки работают так, как документировано.

Ты подменяешь одно другим.

Алсо, ни о какой документации речи не шло, никто никогда не будет работать одними и теми же плагинами одинаково в двух разных программах в реальной жизни. Поэтому корректнее сравнивать работу в одной daw и другой daw как получится, хотя это и выглядит как логика тп на первый взгляд.

В одной и той же программе в реальной жизни не удастся повторить что-то 1 в 1, начиная с нуля. Что уже говорить о двух разных прогах с разными воркфлоу. Один анон мне как-то в разделе писал, что разный результат получается даже при работе за разными железными синтами, вроде бы идентичными. Также, недавно читал, что переменной в "уравнении" при исследованиях может быть сам человек, при, вроде бы, очевидно одинаковых условиях эксперимента. Лично сам замечал, абсолютно по разному идёт работа с гуглом за разными устройствами, в разных местах.

Не вполне понятно (мне по крайней мере не понятно) как именно можно в таких условиях сравнивать работу с одним и другим.

Можно анализировать адекватность восприятия на слух перекодированных по разному звуковых данных, это уже наверное нейронауки этим занимаются. Но если говорить об этом, лично я уже не слышу в том файле который я слушал много раз (возможно это имеет значение(?)) даже очень значительных искажений. Вот к примеру трек, который я вбрасывал в соседний тред (ты 90 процентов тот же анон)

Он перекодирован в саундклаудовские 128 килобит ogg из флака, потом в 320 килобит мр3 (возможно в таком качестве он будет, после того как будет скачен даунлоадером с саундклауда, они все кодируют файл опять в мр3)

То есть цепочка тут flac within temptation - destroyed https://volafile.org/get/BhW_VbMBLfmbI/02 - Destroyed -Unreleased Demo Track.flac => ogg 128 => mp3 320

Ни оригинал, ни перекодированный через жопу именно этот мр3 я на слух не различаю совсем. Хотя искажения значительные.

P.S: В посте отдельно искажения, отдельно mp3, ogg по ссылке https://instaud.io/2MwJ

пиздец запутался после того как написал пост, сложна, нихуя непонятно, как что сравнивать, хуй его знает вообще. нескончаемый поток аудифильщины никогда не кончится. и меня тоже аудиофилом назвали сегодня, охуеть просто, вообще пиздец. пиздец. пиздец. [/spoiler]

>Потом оба образца сравни в программе lacinato abx

Это будет практическая проверка того как ты проходишь слепые тесты, а не того что

>прожки работают так, как документировано.

Ты подменяешь одно другим.

Алсо, ни о какой документации речи не шло, никто никогда не будет работать одними и теми же плагинами одинаково в двух разных программах в реальной жизни. Поэтому корректнее сравнивать работу в одной daw и другой daw как получится, хотя это и выглядит как логика тп на первый взгляд.

В одной и той же программе в реальной жизни не удастся повторить что-то 1 в 1, начиная с нуля. Что уже говорить о двух разных прогах с разными воркфлоу. Один анон мне как-то в разделе писал, что разный результат получается даже при работе за разными железными синтами, вроде бы идентичными. Также, недавно читал, что переменной в "уравнении" при исследованиях может быть сам человек, при, вроде бы, очевидно одинаковых условиях эксперимента. Лично сам замечал, абсолютно по разному идёт работа с гуглом за разными устройствами, в разных местах.

Не вполне понятно (мне по крайней мере не понятно) как именно можно в таких условиях сравнивать работу с одним и другим.

Можно анализировать адекватность восприятия на слух перекодированных по разному звуковых данных, это уже наверное нейронауки этим занимаются. Но если говорить об этом, лично я уже не слышу в том файле который я слушал много раз (возможно это имеет значение(?)) даже очень значительных искажений. Вот к примеру трек, который я вбрасывал в соседний тред (ты 90 процентов тот же анон)

Он перекодирован в саундклаудовские 128 килобит ogg из флака, потом в 320 килобит мр3 (возможно в таком качестве он будет, после того как будет скачен даунлоадером с саундклауда, они все кодируют файл опять в мр3)

То есть цепочка тут flac within temptation - destroyed https://volafile.org/get/BhW_VbMBLfmbI/02 - Destroyed -Unreleased Demo Track.flac => ogg 128 => mp3 320

Ни оригинал, ни перекодированный через жопу именно этот мр3 я на слух не различаю совсем. Хотя искажения значительные.

P.S: В посте отдельно искажения, отдельно mp3, ogg по ссылке https://instaud.io/2MwJ

пиздец запутался после того как написал пост, сложна, нихуя непонятно, как что сравнивать, хуй его знает вообще. нескончаемый поток аудифильщины никогда не кончится. и меня тоже аудиофилом назвали сегодня, охуеть просто, вообще пиздец. пиздец. пиздец. [/spoiler]

8,6 Мб, mp3

8,6 Мб, mp3Объебался с файлом искажений, сорь. В том уже 2-pass, ещё раз кодировано в ogg и mp3

Синты и эффекты в одной и той же прожке не обязаны работать одинаково, потому что некоторые юзают рандом. Далее, через графический интерфейс могут вводиться разные значения параметров и это может создавать дополнительные различия. Поэтому результаты работы разных DAW не обязаны быть идентичными. То, что технически они однохуйственные >>614457, это не предмет дискуссии, это была справочная информация, которую ты должен был принять к сведению, а не писать мистический лозунг "практика- критерий истины". Хуистины.

Те, кто страдает какими-либо беспокойствами о "разнице", "качестве", "математике микширования", могут лишь сравнивать на слух, когда делают одинаковые действия в разных DAW, то есть используют одни и те или аналогичные синтезаторы и эффекты, а так же производят аналогичные операции микширования. Но сравнение на слух - это только слепое тестирование. Других сравнений на слух не бывает.

Сравнение двух треков, которые просто разные, сведены по-разному, когда нахуевертишь разные нагромождения в разных daw - это ваще дно и хуйня, даже по этому поводу фантазировать не нужно.

> Поэтому корректнее сравнивать работу в одной daw и другой daw как получится, хотя это и выглядит как логика тп на первый взгляд

Это и есть логика тп. Ты утверждал не то, что лично у тебя получается разный результат, и в FL - хуже, а то, что FL вносит _искажения_. Так вот чтобы утверждать такое, нужно сравнивать идентичные проекты, чтобы исключить влияние любых других факторов.

По-хорошему надо продуть в каждой DAW синусом \ квадратом с одного и того же синтезатора без каких-либо дальнейших изменений, сделать варианты в разной битности и дискретности, и вот это уже пихать в анализаторы. Ну, если хочется самому убедиться. А так, это цифра, тут нет коэффициента передачи и "нативного шума прибора".

Одно разве что добавлю, в ФЛ ранее были проблемы с воспроизведением большого количества начопанных сэмплов в единицу времени, приводящие к тому, что иногда звук просто заклиповывает всю дорогу на пару секунд. Естественно, это могло случиться и во время экспорта трека.

Ну это потому что сил не хватает у фл много начопанных сжмпло в единицу времени воспроизводить и поэтому движок прокручивает, звуковые шестеренки.

>переменной в "уравнении" при исследованиях может быть сам человек

>ВРЁТИ!! СЛИПЫЙИ ТЕСТЫ НИ РАБОТАЮТ!!!!

>корректнее сравнивать работу в одной daw и другой daw как получится

>технарь

>слышен алиасинг

>Ни оригинал, ни перекодированный через жопу именно этот мр3 я на слух не различаю совсем

Перестань делить на 0.

А я думал, бошку ломал, чего это за хрень необъяснимая. Я этот ФЛ дисторшена на лидах, на высоких частотах слышу иногда. Я уж думал, перекомпрессия что-ли получилась, убирал вообще компрессию... В общем, даже с некоторыми синтами (в основном старыми довольно) расстался даже. Именно на них этот странный дисторшен мне казался. Да, стоит добавить, что при работе в проекте то вроде всё нормально звучало. В общем, у меня тоже странности с ФЛ, подозрения.

Покажи, как ты получаешь дисторшен, покажи все, что ты делаешь со звуком, что за источники и что за обработки.

Вот как пример, какого хуя у тебя интерсэмпловые пики во фруктовой версии? Ты специально их сделал? В рипечьей ты их не сделал, намеренно или случайно, либо кто-то за тебя их постарался избежать.

Я с телефона. Синты - FM8, Redominator, Absynth, Kairatune, Sylenth, Synth1.

Это которые точно помню. Бесплатных много пробовал, часто казалось такое... Повторюсь, казалось на высоких частотах, неприятное искажение.

Обработки, да минимум, компрессор, или Fabfilter или Molot, эквалайзер Fabfilter, панорамирующий какой-нибудь вст., чаще от waves. На мастере Limiter 6 или TDR Limiter6. Всё.

>>614725

Что я должен сказать в ответ на перечисление сторонних плагинов? То, что я просил, по смыслу, означало, чтобы ты продемонстрировал проблему. Ты сказал "перекомпрессия что-ли получилась". О чем ты говоришь? То есть не ты перекомпрессировал, а какие-то неведомые силы тебе вставляли палки в колеса. В общем случае, ты все знаешь, что ты делаешь, ты знаешь, какой звук должен быть, когда ты используешь сознательно выбранные тобой синтезатора и эффекты, но из-за каких-то скрытых причин в DAW, звук портится. По смыслу твое утверждение такое.

Да, примерно такое, звук каким то неведанным образом, кажется, что портится. Дешевеет, алиасинг (удел новичков, ага). Думал, что много жму может, порог или ратио слишком большие.

А моя тетя видела домового. Прям в лаптях.

У меня друг тоже слышит. Вбрасывал ему постоянно результаты работы. Он говорил про хуйню с верхами. А я не слышал нифига, но каждый раз после рендера я вкидывал - и оказывалось что у меня проблемы с верхами. Так до сих пор особо его и не слышу этот дисторшен _ у себя _, но слышу у других. Также как друг, он же слушал свежий материал, новый для него. На своём материале уши замыливаются, привыкают, адаптируются к сигналу. Но на чужом, свежем - всё немного очевидней. Как в таких условиях сравнивать не особо ясно. Надо как-то работать с аудио в слепую так, чтобы материал был каждый раз новым для адекватного сравнения.

Свидетели разницы звучания DAW были подвергнуты естественному отбору и до 2к18 докатились только самые изощренные аморфные формы этих бредней в виде "Что-то слышу, сам не знаю что. Друг у меня слышит, а я у него слышу."

Не звучания daw. Ты жопой читаешь, ищешь только то в сообщениях что уже тебе знакомо, игнорируя новые факты.

Пока я только вижу мутные маневры и таинственные намеки. Если ты в данном споре возник и разговариваешь о чем-то другом, а не мифической "разнице звучания DAW", то это как-то ваще муть. Никаких "новых фактов" ты не сообщил.

Интересно, а какие новые факты ты ждёшь? Научное подтверждение? Или в спектре копаться под микроскопом?

Тебе сказали, что люди слышат. И это не предубеждение какое-то глупое, не домыслы на daw. Я вообще, был до какого-то мнения на стороне ФЛ. Кстати, люди говорили (по вашему, свидетели старого советского хакера), что звук от у тебя говняет daw, я лишь пожимал плечами, и ссылал всё на недостаток опыта. Да и результат на радостях затмевал всё, т.к. реально сразу вроде пошли релизы. Сейчас пришёл к такому выводу, что всё-таки говняет. Может и на спектре не заметно, но что-то не так происходит с ним.

Кстати, на примере к примеру Z3ta+2, Ace слышна ведь разница при смене качества в синте? Вот и тут также, слышно, не глобально, но что-то есть.

Я уже выше говорил про слепой тест и чел с логикой тп (без обид) пытается от этого увернуться. И ты туда же. Слышание - это только когда в слепом тесте. Без слепого теста никаких слышний нет.

Все твои кулстори в духе "я раньше не верил, а потом уверовал, мне открыли глаза светочи древней мудрости." - это просто говорит о том, что тебе строго показаны слепые тесты.

Хуяссека. Всегда ухо врет у фантазеров верунов.

>Или в спектре копаться под микроскопом

Бывают индивиды, которые в двух абсолютно одинаковых звуках слышат разницу. Но это еще нормально. Но бывают такие, когда им покажут, что звук одинаковый, они говорят "ну я же слышу, зачем мне какие-то графики смотреть."

В твоем случае ты пока что просто думаешь, то либо работа плагинов зависит от daw, якобы плагины и daw как-то соединяются друг с другом волшебным образом и вместе рожают звук. Либо у daw бывают этакие таинственные "алгоритмы микширования", которые отличаются от таковых у других daw, что бывает "продвинутая математика суммирования" и продвинутость как-будто может варьироваться.

>слышна ведь разница при смене качества в синте

Всегда за "сменой качества" стоит что-то конкретное, будь то использование чисел двойной точности, будь то оверсэмплинг. Это всегда известно что, не важно, слышишь это или не слышишь, это не предмет мифологии. Звуковые мифы зиждятся на неизвестности и "ну я же слышу", "друг слышит", "мне говорили, а я не верил, но потом удалил серные пробки у отоларинголога и услышал", "я купил новую звуковую карту sound blaster, у нее 24 бит, вот это да, в контерстрайке все шаги слышу".

Не знаю какие из них будут новыми, поэтому перечислю с дополнениями:

1) Слух штука адаптивная. Искажения можно слышать только на новом неизвестном материале с непривычным звуком

2) При работе над своим материалом слух замыливается так, что искажения больше не воспринимаются как негативные и игнорируются.

3) Искажения идут на верхах, на самой проблемной области, где чувствительность слуха достаточно хуёва, и скорее воспринимается как бинарное: есть верха, нет верхов, хуёвые верха, обычные верха, "песок", нет песка.

4) Чтобы понять проблему этих искажений надо работать с аудио в слепую, чтобы итоговый результат был в итоге новым для слуха и неизвестным.

5) Искажения наблюдаются у людей с разным набором применяемых плагинов (это можно понять из треда)

6) Неизвестно какая тут должна быть методология чтоб к чему-то придти конструктивному.

7) У тебя паттерн - "свидетели разницы звучания daw", где надо хейтить даунов, которые не понимают что всё звучит одинаково.

8) Ты, вероятно, не ловишь в сообщении больше одной главной мысли, а остальное игноришь.

Помню где-то был папир, не знаю где его теперь искать, где говорилось про воспринимаемость реконструированных, обрезанных и натуральных верхов в звуковом сигнале, не знаю где его теперь искать. Суть такова - человек всё равно воспринимает тот сигнал, которого "нет", который он не осознаёт. И если этот сигнал есть, то можно подобрать такие его параметры, что сигнал будет восприниматься более приятно, или резко отталкивающим. Хотя формально звук этот вне порога слышимости.

1, 2) Адаптивная штука, устает, отдыхает. Но хуйни к этом лишней придумывать не надо. Мы даже еще не определили, что это за искажения. Это не я виноват, что ты, вы или кто, "что-то слышат", но не знают, что это.

3) На это может влиять алиасинг в одном из твоих плагинов. Но выяснить, как работает каждый плагин можно в слепом тесте, а не переключением настроек и думая, что ты в этом момент можешь сравнивать.

4) а) Создай какой-нибудь короткий отрывок музыки, содержащий какие-нибудь инструменты. По твоей гипотезе, должны быть искажения, которые вносятся не алиасингом синтезаторов и компрессоров, не сатурацией в синтах и эффектах, а дав вносит. Перенеси все пресеты в другую дав и отрендерь два образца. В слепом тесте проверь, есть ли разница.

b) Микшер любой daw точней, чем ты можешь себе представить. Нигде в мире ты не найдешь средств для воcпроизведения звука с такой точностью, чтобы можно было зафиксировать какие-нибудь огрехи сложения, умножения, которые производит микшер с числами с плавающей точкой. Просто пойми это мозгом и не нужно будет переживать или возиться с тестами.

5) Алиасинг везде однохуйственный, во всех твоих синтах. В самой DAW-его нет.

6) Если сам не будешь придумывать уход от выяснения сути, а будешь придумывать условия невозможности опровержения твоей гипотезы, то из этого просто будет следовать и следует и так отсутствие эмпирических данных, а их них следует воображаемость искомого. Но в данном случае у нас что-то существующее могло быть идентифицировано неправильно. Люди часто всякую хуйню видят и думаю, что это снежный человек.

7) Хуяттерн. Ты говоришь "слышу то, не знаю что". Сформулируй по-другому, например, "я иногда слышу алиасинг некоторых говносинтов, но в слепом тесте я свои плагины не проверял, поэтому не могу утверждать точно"

8) Не.

Нет, адаптивность это способность привыкать, приспосабливаться.

Ты привык и всё. С этим ничего не сделаешь, сигнал заебись, он замыленный, у него исчезают недостатки. Синт, эффект, не важно что. Пока работаешь - уже всё. Можно хоронить. Адаптировался. Но не смотря на то что ты привык, всё равно знаешь что какая-то происходит хуйня. (тут из последнего безымянного пункта, если вдруг. с конкретной ссылью на папир напряг) Поэтому надо делать в слепую, иначе адаптируешься и всё, можно закапывать.

Тебе это не очевидно, я так понял, поэтому раскрою.

Ты предлагаешь делать какой-то слепой тест. Не знаю из какого материала и зачем, что будет сравниваться - мне непонятно. Разные daw? Так уже всё, это твой синт, твой микс, ты к нему привык пока работал. То есть приехали. Сравнение уже невозможно, потому что тест уже не слепой. Ты уже слышал этот сигнал длительное время.

А надо чтоб не слышал, надо чтоб сигнал был новым и невозможно было успеть адаптироваться.

Ты просто придумал отмазку от сравнивания в слепом тесте одинаковых проектов сделанных в разных daw и прикидываешься, типа не пониаешь, что с чем сравнивать. "Что-то есть, но мы это не слышим и не сможем никак проверить". Нефальсифицируемая хуйня называется. Как и твоя гипотеза о перманентном замыливании.

Но вопрос о твоих личных слуховых глюках и квалиа - это последнее что мне интересно. Это твоя проблема, ты слышишь голоса усопших - это лечится слепыми тестами. Я сказал, как проверить. Не хочешь - твоя проблема.